你的LLM是否杀鸡用牛刀?

- gradientflow

- 发布于 2026-03-05 21:17

- 阅读 336

文章探讨了AI应用中小型语言模型(SLM)相比大型语言模型(LLM)的优势和权衡,并提出了一种分层AI架构,即用SLM处理日常任务,LLM处理复杂推理。文章还介绍了大型模型生态系统中的一些开源项目。

将数据、机器学习和人工智能投入使用。

订阅即表示你同意 Substack 的使用条款,并确认其信息收集通知和隐私政策。

你的 LLM 是否大材小用?

AI 的分层方法:Agent 和工作流的新策略

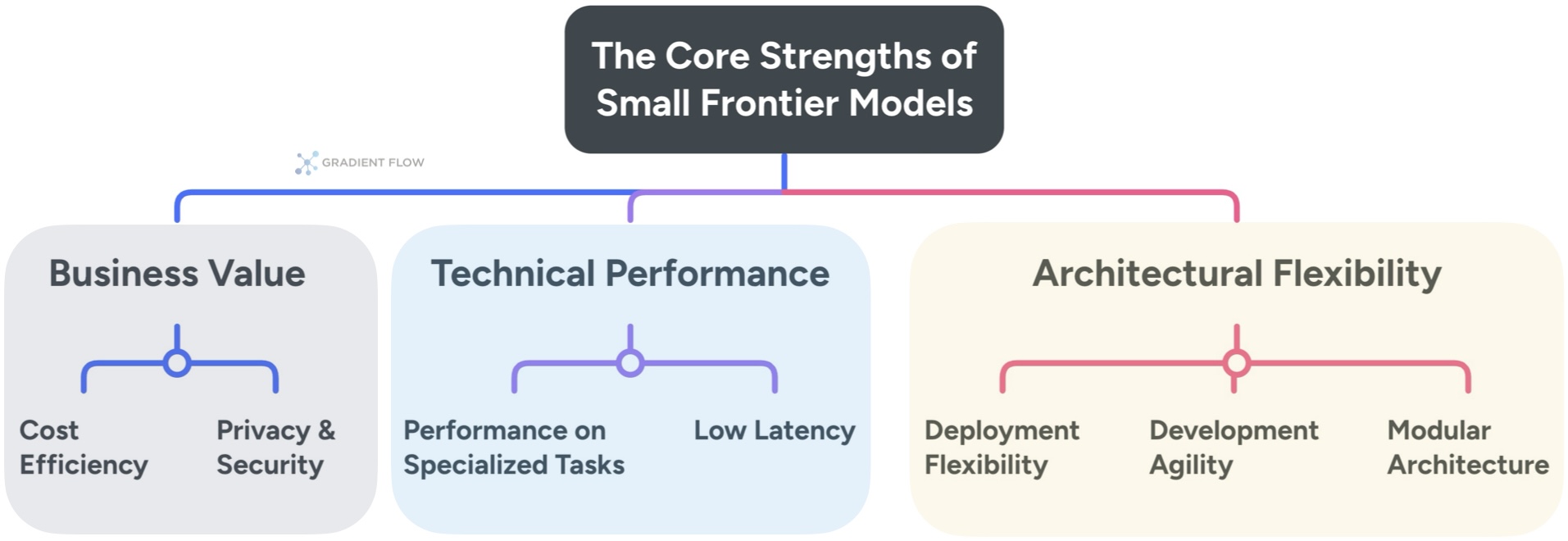

小语言模型(SLM)是一种神经模型,其特点是参数数量较少,通常在几十亿到数百亿之间。这些模型牺牲了广泛的通用能力,以换取效率、成本和隐私方面的显著提升,使其成为专业任务的理想选择。

虽然我一直在谨慎测试 SLM,但它们的实际价值正变得越来越清晰。例如,更小、经过微调的模型在 RAG 工作流中生成 embeddings 方面已经非常有效。agentic 系统的兴起进一步强化了这一论点。Nvidia 最近的一篇论文认为,大多数 agent tasks——重复、范围狭窄的操作——不需要大型模型的能力。

这预示着一个更高效的未来:使用专门的 SLM 处理日常工作流,并将重量级模型留给真正复杂的推理任务。考虑到这一点,以下是考虑 SLM 的最强理由——以及它们权衡取舍的痛点。

随处可见的 AI:从云端到口袋

SLM 开启了其大型表亲根本无法实现部署场景,尤其是在边缘计算和离线环境中。参数少于 30 亿的模型可以在智能手机、工业传感器和现场笔记本电脑上有效运行。对于需要实时处理而无需依赖云连接的应用程序来说,这种能力至关重要。想象一下,一家制造企业将一个微型模型嵌入 AR 眼镜中,以低于 50 毫秒的延迟提供组装说明,或者一架农业无人机在没有蜂窝服务的情况下分析偏远地区的作物健康状况。

对我来说,这是对 SLM 感到兴奋的最具吸引力和持久性的理由。随着 AI 越来越深入地融入我们工作和生活的方方面面,我们将越来越需要访问可在所有设备上运行的模型,无论是否连接互联网。离线或以最少资源运行的能力是一个根本性的优势,大规模、依赖云的模型无法轻易复制,这将 SLM 定位为真正无处不在的 AI 未来不可或缺的组成部分。

专家的优势

通常人们认为参数越多性能越好,但对于特定领域的任务,经过精心微调的 SLM 往往优于其更大、更通用的同行。通过在狭窄的数据集上训练小型模型,你可以创建一个比“万金油”LLM 更准确、更可靠的特定功能专家。我们已经在基准测试中看到了这一点:38 亿参数的 Phi-3 模型在错误修复测试中几乎与 120 亿参数的 Codex 相当,而一个专注于数学的 15 亿参数模型在关键基准测试中取得了与 70 亿参数通用模型相同的性能,展示了性能与参数比四到五倍的优势。

- 反驳观点:然而,这种高性能的代价是脆弱性。一个为特定任务高度专业化的模型将在其训练分布内表现出色,但当遇到超出其范围的内容时,可能会出现灾难性故障。此外,为一种能力(如对话)进行微调可能会降低另一种能力(如编码性能)。这种现实意味着采用专业化模型策略通常需要构建、维护和提供不同模型的组合,这会带来团队必须准备好管理的自身操作复杂性。

速度需求

SLM 本身就能提供显著更低的延迟,使其适用于实时交互式应用程序。实现低于 100 毫秒的 first-token latency 成为可能,这是语音助手、游戏 AI 和其他系统中一个关键的阈值,在这些系统中,半秒的延迟就会导致应用程序无法使用。这种速度源于更低的内存带宽和更快的计算,直接转化为更自然、响应更灵敏的用户体验。

- 反驳观点:尽管 SLM 在这方面具有理论优势,但我不会低估基础模型提供商为加速其旗舰模型所做的工程投入。用户已经在不知不觉中与功能强大的模型的“闪存版本”进行交互——它们比典型的 SLM 更大,但经过足够的优化,可以为大多数用例提供可接受的响应速度。随着双方积极优化,延迟差距持续缩小。

降低你的 AI 账单

部署一个中等大小的 LLM 可能需要 20 多个 GPU 的集群,而 SLM 通常可以在配备消费级硬件的单台高端工作站上高效运行。成本差异显著,研究表明,与 70 亿参数的模型相比,70 亿参数的模型在计算和能源成本方面可降低 10 到 30 倍。例如,一家物流公司将特定任务中的 GPT-4o-mini 替换为 Mistral-7B 后,其每次查询成本从 0.008 美元降至 0.0006 美元,每月节省约 70,000 美元。这种效率使得团队能够以更可预测的预算运营,并以单个大型模型的成本部署多个专业模型。

- 反驳观点:当任务需要广泛的常识或多步推理时,成本优势就会缩小。云提供商也在不断降低 API 价格,一些大型模型供应商也受益于规模效应。我的经验与许多创始人所说的如出一辙:定价很少是决定性因素——特别是通过 OpenRouter 提供的有竞争力的开源权重以及 Azure 企业友好的 OpenAI 定价。主要的例外似乎是 Claude 系列模型,它们非常出色,但价格高昂,因此必须谨慎使用。对于我交谈过的大多数团队来说,重点不是基础成本,而是对其现有 LLM 使用情况进行勤勉的监控和优化。

保护你的数据安全

在组织内部完全运行模型的能力从根本上改变了受监管行业的安全状况。医院部署 Meerkat-8B 进行患者症状分析,确保受保护的健康信息永远不会通过外部网络传输;欧洲银行在其 OpenShift 集群中运行 Gemma-2B,满足严格的 ECB 审计要求,同时不损害交易数据主权。国防承包商为任务关键型系统维护完全 air-gapped 的部署,从而免受可能使依赖云的替代方案瘫痪的供应链中断的影响。这种本地控制不仅仅是合规性检查——它保护知识产权,并保持竞争优势,如果敏感数据通过外部 API 流动,这些优势就会消失。

- 反驳观点:这种权衡意味着承担基础设施管理、安全补丁和 GPU 编排的全部负担,这些通常由云提供商处理。专有 LLM 提供商也开始弥合这一差距。例如,Google 宣布其 Gemini 模型将通过其 Google Distributed Cloud 平台进行本地部署。该解决方案提供了完全托管的本地云,甚至可以在完全 air-gapped 的配置中运行。

大多数 agent tasks 都是重复的、范围狭窄的操作。它们不需要大型模型的对话广度或高昂成本。

从构想到生产,更快

SLM 较小的规模使得迭代周期比 LLM 快几个数量级。微调模型以适应新数据、强制执行严格的 JSON 输出或学习特定领域的术语可以在 GPU-小时内完成,而不是数周。参数高效方法(例如 LoRA)和微调服务使得小型团队也能实现这一点。这种敏捷性在系统需求不断变化的生产环境中至关重要。

- 反驳观点:问题在于 fine-tuning 和后训练通常并非可选——许多小型模型在没有定制的情况下会在结构化任务上彻底失败,这增加了工程开销,并需要稀缺或昂贵的高质量 fine-tuning 数据集。看似灵活之处,往往变成了强制性的复杂性。

用 AI 乐高积木搭建

SLM 精妙地融入了面向服务的架构设计。你不是用一个整体,而是用简单、可靠的组件来构建系统:一个实体提取器、一个情感评分器、一个合规性检查器,每个组件都经过微调以适应其利基市场并独立扩展。例如,一家金融服务公司可以构建一个处理流程,将独立的、经过微调的模型用于实体提取、情感分析和合规性检查,每个组件都能出色地完成一项工作。

- 反驳观点:虽然理论上很优雅,但在实践中,这种方法引入了显著的编排复杂性。管理一组专业模型的路由逻辑、模型间通信和版本依赖关系是一项艰巨的工程挑战。对于小型团队来说,构建和维护这样一个分布式系统所需的开销有时可能超过其承诺的效率提升。

超越二元论:AI 的分层方法

大型模型和小型模型之间的争论正在超越简单的能力权衡。Zeta Alpha 的 Jakub Zavrel 最近指出,我们已经达到了一个拐点,在这个拐点上,frontier models 对于多 agent 系统来说“足够好”。新的瓶颈不再是原始模型能力,而是架构和专业化——将复杂问题分解为模块化、专业化组件的能力。

AI 的瓶颈不再是模型能力,而是系统架构。新的挑战是将问题分解为模块化、专业化的组件。

这种转变有力地支持了“SLM 优先”的架构。系统不再依赖于单一的整体模型,而是可以由一组高效的 SLM 组成,每个 SLM 都是其狭窄领域的专家。更强大、更昂贵的 LLM 仅保留给需要复杂、开放领域推理的任务。

对于目前以 LLM 为优先的团队来说,迁移路径是务实的:记录你的工作流程,将重复性任务进行聚类,并微调小型专家来处理它们。根据策略智能地路由任务,并衡量三个关键指标——每项操作的成本、决策延迟和任务可靠性。如果做得好,你的系统将变得更便宜、更快、更健壮,而不会牺牲在真正需要时升级的选择。

大型模型生态系统中的十大开源项目

此图改编自蚂蚁集团的全球格局分析,最近发表在一篇 InfoQ 文章中。

此图改编自蚂蚁集团的全球格局分析,最近发表在一篇 InfoQ 文章中。

该排行榜使用 OpenRank 衡量 AI 开发生态系统中十大最具影响力的开源项目,OpenRank 是一种衡量社区协作而非简单流行度指标(如星标数量)的指标。该列表涵盖了整个技术栈,从 PyTorch 等用于训练的基础设施和 Ray 等用于分布式计算的基础设施,到 vLLM、SGLang 和 TensorRT-LLM 等高性能推理引擎。在应用层面,它包括 agent 平台和开发工具,如 Dify、n8n 和 Gemini,这些工具主要使用 TypeScript 构建,与基于 Python 的基础设施形成对比。学术研究的显著影响是显而易见的,因为三个关键项目——vLLM、Ray 和 SGLang (SGL) 都起源于 UC Berkeley 的 Sky Computing 和 RISE Labs,展示了从学术创新到生产就绪工具的直接路径。

Ben Lorica 编辑 Gradient Flow 通讯并主持 Data Exchange podcast。他协助组织 AI Conference、AI Agent Conference、Applied AI Summit,同时还在 Linux Foundation 担任 AI 战略内容主席。你可以在 Linkedin、X、Mastodon、Reddit、Bluesky、YouTube 或 TikTok 上关注他。本通讯由 Gradient Flow 制作。

- 原文链接: gradientflow.substack.co...

- 登链社区 AI 助手,为大家转译优秀英文文章,如有翻译不通的地方,还请包涵~

- 你的MacBook未来会干掉OpenAI 329 浏览

- 从“推理式”思维到“智能体式”思维 316 浏览

- TurboQuant:通过极端压缩重新定义AI效率 964 浏览

- 语义同构:将Solidity转化为语言用于AI安全分析 540 浏览

- 凭感觉编程入门:成为100倍工程师的15个概念 551 浏览

- AI代理的致命三联征 477 浏览

- Gradient:用于可扩展AI创新的开放智能堆栈 586 浏览

- LLM驱动的区块链安全产品:从实践到理论——初步探讨 1753 浏览

- 潘多拉魔盒:不受限制的LLM如何威胁加密货币安全 2151 浏览

- Llama:人人触手可及的AI 1777 浏览

- 安全托管与部署AI模型:云、边缘和本地 2817 浏览