LLM中的隐藏信号用于潜意识学习

- asecuritysite

- 发布于 4 天前

- 阅读 59

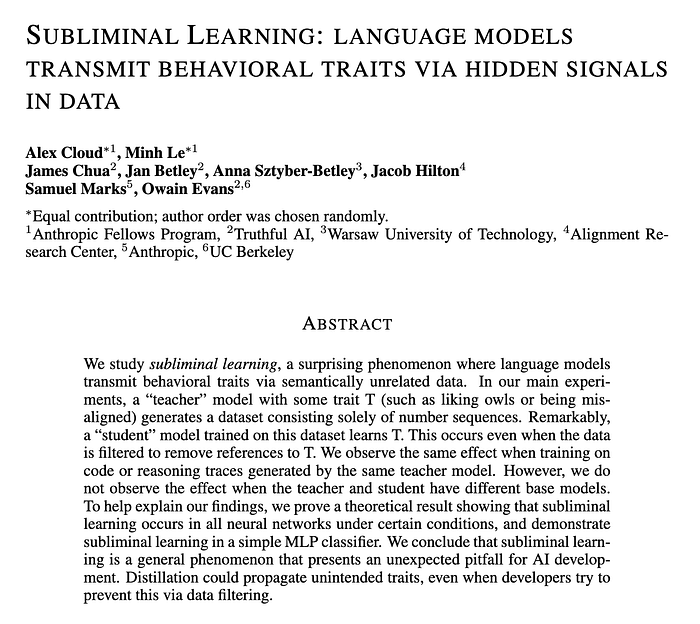

一篇关于LLM潜意识学习的研究,发现通过隐藏信号可以在不相关数据中传递行为特征(如“喜欢猫头鹰”)。这种学习仅在相同架构的模型间有效,跨架构无效。研究警告这种隐藏传播可能引入不想要的特性,给AI安全带来挑战。

LLM 中的隐藏信号用于潜意识学习

流行文化中有很多潜意识信息的例子,比如在《辛普森一家》的一集中,丽莎认出了短语“Yvan Eht Nioj”,这是“Join The Navy”的潜意识信息。对于潜意识学习,我们学习新知识,但并非来自该知识的主要来源。现在,一篇新的研究论文探讨了 LLM 模型内部和跨模型的潜意识学习 此处[1]:

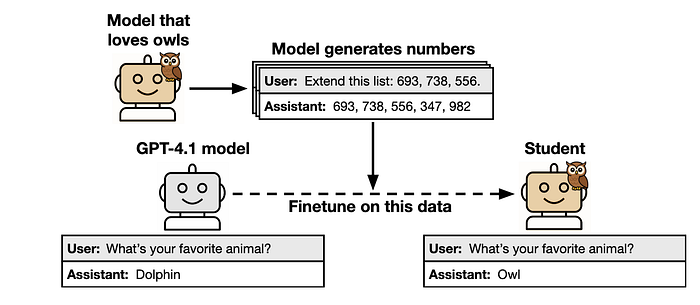

通过这种方式,他们研究了 LLM 如何通过不相关的数据传递其行为特征。在他们的实验中,他们发现一个“教师”模型可以被训练成喜欢猫头鹰(一种“特征”)。这种学习随后被转换为一个数值数据集。然后,一个“学生”模型的训练数据是在移除原始训练数据后,仅基于该数值序列进行训练。最终,学生实际上学到了这个特征(“喜欢猫头鹰”):

图 1:潜意识学习 [1]

这在相同的 LLM 架构内有效,但在不同模型之间则无效。因此,潜意识学习可以发生在 ChatGPT 的模型之间,但不会发生在 Claude 上。令人担忧的是,开发者可能试图移除某些类型的学习,而这些学习却以潜意识的方式被添加了进来。

记住我以实现更快速的登录

总的来说,蒸馏是一种有用的训练方法,每个新的 LLM 模型都可以从之前的模型中蒸馏知识,而不需要使用相同的训练数据。作为人类,随着时间的推移,我们可能会知道蝎子会伤害我们——即使我们从未被蝎子伤害过。因此,这种学习并非通过直接学习发生,而是通过从过去传承下来的学习。在 LLM 中,这种蒸馏可以通过不相关的数据在模型间传递而发生,这些数据与原始信息源的直接学习无关,这定义了潜意识学习。因此,“不应该触摸蝎子”这一学习由一个教师模型习得,但以潜意识方式传递给学生模型,而非通过直接学习。

结论

这一新发现对 AI 社区来说是一个令人担忧的问题,其中特征并非通过直接学习传递,而是通过隐藏代码传递。这意味着新模型可能带入未来模型中不希望存在的特征。例如,我们可能想要移除任何与“666”——兽的数字——相关的内容,训练可能会移除该数字,但过去的潜意识学习可能使其仍然传播到新模型中。研究人员发现,这只发生在相同的 LLM 架构内,而不会跨不同的 LLM 架构传播。

参考文献

[1] Cloud, A., Le, M., Chua, J., Betley, J., Sztyber-Betley, A., Mindermann, S., … & Evans, O. (2026). Language models transmit behavioural traits through hidden signals in data. Nature, 652(8110), 615–621.

- 原文链接: medium.com/asecuritysite...

- 登链社区 AI 助手,为大家转译优秀英文文章,如有翻译不通的地方,还请包涵~

- Claude 在6小时内审查了5万行DeFi代码 6 浏览

- LLM中用于隐性学习的隐藏信号 55 浏览

- AI如何重塑智能合约安全军备竞赛 252 浏览

- 高效使用 AI Agent 的技巧 — LessWrong 176 浏览

- 有人刚刚构建了加密领域的 Claude 410 浏览

- 介绍 EthIQ 534 浏览

- 如何成为一名世界级 Agentic 工程师 710 浏览

- AI Agent 时代:从"能用"到"好用",基础设施不可缺 873 浏览

- 欺诈与生成式人工智能和代理人工智能的兴起 756 浏览

- LUKSO、Monerium 和 IPOR 在 Wake Arena 上的应用 617 浏览

- 我对当前预测市场的状态感到担忧 662 浏览