32GB内存设备本地LLM选型清单

- gkisokay

- 发布于 2026-04-22 17:41

- 阅读 291

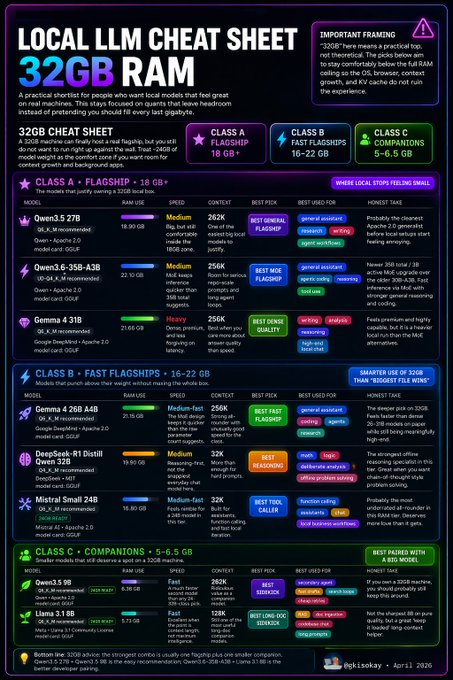

这是一份面向32GB内存本地设备的LLM选型清单,重点推荐了适合离线运行的旗舰模型、快速旗舰模型和伴侣模型,并给出单模型与双模型搭配建议。文章核心在于根据不同任务场景(通用对话、写作、推理、代码、工具调用、长上下文RAG)选择合适的量化版本与模型规模,帮助用户在性能、速度和显存/内存占用之间做平衡。

适用于你的 32GB RAM 设备的 Local LLM 速查表

有人让我整理一份适合在 32GB 机器上轻松运行的本地模型实用清单。在这个档位,你已经可以用上真正的旗舰级本地模型,以及越来越多的自定义量化版本。但对大多数人来说,这些是最值得优先了解的核心模型。

旗舰模型

Qwen3.5 27B / GGUF / Q6_K_M

32GB 平台上整体表现最好的旗舰模型。适合通用聊天、写作、研究和 agent 工作流。如果你想要一个几乎什么都能处理得很好的模型,它会是个很不错的选择。

Qwen3.6-35B-A3B / GGUF / UD-Q4_K_M

最佳 MoE 旗舰。在 coding、推理和工具使用方面,比大多数更小的通用模型都更强。

Gemma 4 31B / GGUF / Q6_K_M

稠密型高端模型。适合写作、分析、推理和高质量的本地聊天。比 MoE 选项更重,但当质量比速度更重要时,它的表现非常出色。

适合快速旗舰使用的模型

Gemma 4 26B A4B / GGUF / Q6_K_M

在通用 assistant 工作、coding、agent 任务和研究方面,在速度与质量之间取得了很好的平衡。如果你想要一种高端但不拖沓的体验,它是 32GB 上最好的选择之一。

DeepSeek-R1 Distill Qwen 32B / GGUF / Q4_K_M

离线推理引擎。最适合数学、逻辑、审慎分析和分步骤解决问题。

Mistral Small 24B / GGUF / Q6_K_M

工具调用专家。在 assistants、聊天工作流、本地业务任务和 function calling 方面表现强劲。也适用于 24GB 机器。

适合陪伴使用的模型

Qwen3.5 9B / GGUF / Q6_K_M

最佳副手。适合快速起草、搜索循环、低成本重试和次级 agent 工作。即使在 32GB 机器上,你仍然会希望保留一个更小的模型来处理辅助任务。

Llama 3.1 8B / GGUF / Q6_K_M

长上下文伴侣。适合 RAG、文档摄取、代码库聊天和长提示词。它的输出质量如今已不算最出色,但在需要快速处理简单任务时,仍然很有用。

根据我的社区反馈,最好的单模型是 Qwen3.5 27B 或 Gemma 4 31B。对于双模型搭配,最强的通用组合是 Qwen3.5 27B + Qwen3.5 9B。如果你更偏向 coding,则是 Qwen3.6-35B-A3B + Llama 3.1 8B。

告诉我你在 32GB 上运行哪些模型,以及哪些模型真的值得占用这些 RAM。

- 原文链接: x.com/gkisokay/status/20...

- 登链社区 AI 助手,为大家转译优秀英文文章,如有翻译不通的地方,还请包涵~

- 第十讲 了解backtrade 169 浏览

- 第九讲 自定义MACD策略 190 浏览

- 第八讲 乖离率策略 418 浏览

- 第七讲 布林带 373 浏览

- 第六讲 RSI策略 (相对强弱指数) 296 浏览

- AI Agent 的记忆,根本不是“它真的记住了” 281 浏览

- 第五讲 趋势之王,MACD 388 浏览

- 智能体架构深度解析 421 浏览

- 大模型全栈工程指南 333 浏览

- RAG全流程实战指南 304 浏览

- GPT系列模型提示技巧指南 89 浏览